U bent hier

Privacy

Persoonlijke data bijna gehele bevolking El Salvador gelekt op internet

New policy paper on access to publicly funded research

Published research outputs often end up locked behind paywalls, unavailable to many researchers and the broader public, impeding scientific – and human – progress. Despite progress in the area of open science, research funded by the European public is no exception to this. In many cases, European taxpayers are essentially asked to pay up twice, once for funding the research and again for access to the final publication. One reason for this is the transfer of copyright ownership. To comply with contractual demands, researchers routinely outright transfer their economic exploitation rights to publishers, or fail to retain sufficient rights that would allow them or their funders to republish or reuse their work. This contradicts the primary goal of research, which is to maximise its impact by sharing it as widely as possible in a timely manner.

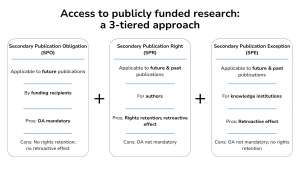

Today, COMMUNIA is releasing Policy Paper #17 on access to publicly funded research (also available as a PDF file), in which we propose a targeted intervention in European copyright law to improve access to publicly funded research:

We recommend a three-tiered approach to open publicly funded research outputs to the public, immediately upon publication, where a secondary publication obligation co-exists with a secondary publication right. We consider that an obligation by the funding recipients to republish is a more consequential approach to protect the public interest, as it makes Open Access (OA) mandatory, ultimately ensuring that publicly funded research outputs are republished in OA repositories. A right is, however, necessary to ensure that the authors, and subsequently the funding recipients, retain the rights necessary to comply with the obligation. A right also provides a legal framework for the dissemination in OA repositories of publicly funded research outputs published before the entry into force of a secondary publication obligation.

In addition, we recommend the introduction of a copyright exception for the benefit of knowledge institutions, such as libraries and archives, to further support the task of making available research outputs published before the entry into force of secondary publication rights and obligations.

Resolving these issues would ideally be part of a more comprehensive regulation, a Digital Knowledge Act, which addresses the needs of research organisations and other knowledge institutions in the digital environment more broadly.

The post New policy paper on access to publicly funded research appeared first on COMMUNIA Association.

Biden overweegt om aanklachten tegen Julian Assange te laten vallen

VS maakt systeem voor analyseren malware beschikbaar voor publiek

Software alarmsysteem lekte jaar lang duizenden adressen en afmeldcodes

Amerikaanse rechter weigert video als bewijs vanwege gebruik AI-software

Een Amerikaanse rechter heeft geweigerd dat een video als bewijs wordt gebruik in een rechtszaak vanwege het gebruik van AI-software bij het bewerken van de video. Dat meldde Tweakers vorige week. Door gebruik van de software wilde de aanklager duidelijker maken dat het inderdaad ging om de verdachte.

Wat ging er nou precies mis? De aanklager gebruikte Topaz Video AI om de video te upscalen, meldt NBC News. De software van het Amerikaanse bedrijf herkent gezichten en vult vervolgens details aan die niet in het oorspronkelijke beeld zaten. Dat is problematisch, zo redeneert de rechter, want de software ‘leunt op vage methoden om te bepalen wat het AI-model denkt wat we moeten zien’, aldus de rechtbank. Topaz is videobewerkingssoftware: je kunt er beeld mee opknappen, zoals door het er scherper laten uitzien. Dat is mooi voor die vakantiefoto die niet helemaal goed gelukt is, of voor het aanvullen van beeld voor je reclamecampagne dat nét even iets extra’s nodig heeft.

Specifiek bij bewijs is dat allemaal net iets spannender. Het is natuurlijk prima als het bewijs beter te beoordelen wordt, maar dat moet niet gebeuren door er dingen bij te verzinnen, hoe mathematisch logisch het ook lijkt dat die pixels er tussen moeten.

Het plaatje rechtsboven (van een experiment uit 2020 met hetzelfde doel) laat zien waarom: de dataset daarvan bevatte geen gezichten van kleur, waardoor de bekende foto van president Obama opgewerkt werd tot geheel iemand anders. Een recenter voorbeeld was beeldbewerkingssoftware die ongevraagd acteur Ryan Gosling toevoegde aan een video.

Mag dit nou van de AI Act? Ik zit even te peinzen of dit telt als biometrie, maar interpolatie van pixels kan ik moeilijk gelijk stellen aan analyse van gezichtskenmerken. Op de lijst (Annex III) staan wel diverse vormen van AI-gebruik door wetshandhaving, waar naast de politie ook het OM onder valt:

- AI systemen gebruikt als leugendetector

- AI om de betrouwbaarheid van bewijs te evalueren

- AI om recidivisme in te schatten (waarbij meer dan profiling wordt gebruikt, want anders is het verboden)

- AI voor het profileren van mensen in het kader van opsporing en vervolging

Ook zullen dit soort systemen onder de transparantie-eis van “synthetic output generator” AI vallen. Die moeten zorgen dat hun beeld onzichtbaar en robuust gewatermerkt is zodat andere systemen (zoals het uploadformulier van Facebook) kan signaleren dat er synthetische afbeeldingen worden geupload.

Naar de letter van de wet is zulk beeld zelfs een deepfake: “deepfake”: door AI gegenereerd of gemanipuleerd beeld-, audio- of videomateriaal dat een gelijkenis vertoont met bestaande personen, voorwerpen, plaatsen of andere entiteiten of gebeurtenissen, en door een persoon ten onrechte voor authentiek of waarheidsgetrouw zou worden aangezien; Twintig bij twintig pixels uitvergroot en bewerkt zodat je er Ryan Gosling in ziet, lijkt mij wel “een gelijkenis vertonen” waardoor je ten onrechte het beeld voor waarheidsgetrouw aan gaat zien. Dit beeld moet dus expliciet gemarkeerd worden als niet-authentiek.

Is hiermee alle gebruik van beeldbewerking verboden? Nee. Nog even los van dat dit één uitspraak is; de betrouwbaarheid van via ict verkregen bewijs vaststellen is al decennia een aandachtspunt. AI maakt het manipuleren van bewijs eenvoudiger en sneller, maar dat is geen fundamenteel nieuwe kwestie.

Arnoud

Het bericht Amerikaanse rechter weigert video als bewijs vanwege gebruik AI-software verscheen eerst op Ius Mentis.

X herstelt probleem met automatisch aanpassen van url's met Twitter.com

AT&T waarschuwt 51 miljoen klanten voor datalek met persoonsgegevens

E-maildienst Tuta blokkeerde door update ip-adres van honderden gebruikers

DNB test via red teaming cybersecurity kleinere banken en verzekeraars

Proton neemt versleutelde notitie-app Standard Notes over

WhatsApp moet open van Europa en dat kan veilig, maar kent ook risico’s

Git repositories datacompressietool XZ weer beschikbaar op GitHub

NSC wil opheldering over dalend aantal bankkantoren in Nederland

Microsoft beschrijft oorzaak eigen kwetsbaarheden via CWE-standaard

Kleine browsers melden toename marktaandeel door DMA-keuzescherm

IMF: cyberaanvallen kunnen financiële en economische stabiliteit bedreigen

Microsoft verhelpt twee actief aangevallen zerodaylekken in Windows

LG dicht kwetsbaarheden waardoor televisies op afstand zijn over te nemen

Pakje sigaretten kopen? Eerst even je gezicht scannen, mag dat?

Wie een pakje sigaretten koopt, komt op steeds meer plekken in Nederland een gezichtsscanner tegen. Dat las ik bij RTL Nieuws onlangs. De scanner schat je leeftijd (25+ of niet) en laat je dan sigaretten kopen (of niet). Enkele rokende lezers stelden me vervolgens de vraag: mag dat eigenlijk wel, inzet van biometrie voor zo’n profileringsdoel? En vooral: wat zegt de aankomende AI Act?

De AI Act is definitief maar nog niet aangenomen (in mijn nieuwe boek lees je alle details). Dat zal in mei gebeuren. Daarna is er twee jaar overgangsrecht, hoewel de zogeheten verboden praktijken al over zes maanden moeten stoppen. En in die lijst (artikel 5) staan de nodige biometrische toepassingen:

- Emotieherkenning op het werk en in het onderwijs, behalve indien noodzakelijk voor veiligheid of medische redenen (art. 5(1)(f)).

- Biometrische categorisatie op bijzondere persoonsgegevens, zoals het afleiden van etnische afkomst of seksuele voorkeur (art. 5(1)(g)).

- Real-time biometrie op afstand in de openbare ruimte voor wetshandhaving (art. 5(1)(h)))

Diverse toepassingen van biometrie zijn als hoogrisico aangemerkt. De AI Act is daar formeel in; iets is hoogrisico als het op de lijst (Annex III) staat, je hoeft geen eigen inschatting te maken van hoe hoog of hoe ernstig het in jouw geval is. Pas je onder een tekst? Dan ben je hoogrisico.

De eerste toepassing is biometrie op afstand. De AI Act gebruikt hierbij niet een criterium uitgedrukt in meters, maar of je meerdere mensen tegelijkertijd scant (overweging 17, artikel 3 lid 41), met “typisch op afstand” als optionele toevoeging.

De tweede toepassing is emotieherkenning (dus niet op werk of school). Dit is niet van toepassing, want leeftijd is geen emotie.

Blijft over biometrische categorisatie op basis van gevoelige of beschermde kenmerken. Dit komt goed in de buurt: de categorieën zijn dan “25 jaar of ouder” versus “jonger dan 25”, en dit gebeurt op basis van gezichtskenmerken die goed ‘gevoelig’ kunnen zijn. Daarmee moet de leverancier aan een hele berg compliance-verplichtingen voldoen.

Die 25 jaar is overigens gekozen om de foutmarge naar 2% terug te dringen: het verschil zien tussen 17 en 19 is te subtiel kennelijk.

Waar ik vooral mee zit: de gezichtsscan duurt zo te zien op het filmpje minstens zo lang als een ID-kaartscan. (De leverancier spreekt van “rap” maar ik zie echt het tijdsverschil niet.) Je ID moet je altijd kunnen laten zien. Wat is dan precies nog het praktische voordeel van deze AI oplossing ten opzichte van altijd ID laten zien?

Arnoud

Het bericht Pakje sigaretten kopen? Eerst even je gezicht scannen, mag dat? verscheen eerst op Ius Mentis.

![Reference manager - [Onderhoud aantekeningen]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BOnderhoud%20aantekeningen%5D%2014-2-2010%20102617_0.jpg?itok=OJkkWhxY)

![Reference manager - [Onderhoud aantekeningen]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BOnderhoud%20aantekeningen%5D%2014-2-2010%20102628.jpg?itok=CUvhRRr7)

![Reference manager - [Onderhoud bronnen] - Opnemen en onderhouden](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BOnderhoud%20bronnen%5D%2014-2-2010%20102418.jpg?itok=d7rnOhhK)

![Reference manager - [Onderhoud bronnen]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BOnderhoud%20bronnen%5D%2014-2-2010%20102433.jpg?itok=CgS8R6cS)

![Reference manager - [Onderhoud bronnen]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BOnderhoud%20bronnen%5D%2014-2-2010%20102445_0.jpg?itok=4oJ07yFZ)

![Reference manager - [Onderhoud bronnen]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BOnderhoud%20bronnen%5D%2014-2-2010%20102500.jpg?itok=ExHJRjAO)

![Reference manager - [Onderhoud bronnen]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BOnderhoud%20bronnen%5D%2014-2-2010%20102524.jpg?itok=IeHaYl_M)

![Reference manager - [Onderhoud bronnen]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BOnderhoud%20bronnen%5D%2014-2-2010%20102534.jpg?itok=cdKP4u3I)

![Reference manager - [Onderhoud thema's en rubrieken]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BOnderhoud%20themas%20en%20rubrieken%5D%2020-9-2009%20185626.jpg?itok=zM5uJ2Sf)

![Reference manager - [Raadplegen aantekeningen]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BRaadplegen%20aantekeningen%5D%2020-9-2009%20185612.jpg?itok=RnX2qguF)

![Reference manager - [Relatie termen (thesaurus)]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BRelatie%20termen%20%28thesaurus%29%5D%2014-2-2010%20102751.jpg?itok=SmxubGMD)

![Reference manager - [Thesaurus raadplegen]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BThesaurus%20raadplegen%5D%2014-2-2010%20102732.jpg?itok=FWvNcckL)

![Reference manager - [Zoek thema en rubrieken]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BZoek%20thema%20en%20rubrieken%5D%2020-9-2009%20185546.jpg?itok=6sUOZbvL)

![Reference manager - [Onderhoud rubrieken]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%2020-9-2009%20185634.jpg?itok=oZ8RFfVI)

![Reference manager - [Onderhoud aantekeningen]](https://labyrinth.rienkjonker.nl/sites/default/files/styles/medium/public/Reference%20manager%20v3%20-%20%5BOnderhoud%20aantekeningen%5D%2014-2-2010%20102603.jpg?itok=XMMJmuWz)